L’intelligenza artificiale nei motori di ricerca e la sua dubbia utilità

Nonostante non segua molto gli argomenti in auge nel mainstream, nè in generale le notizie di cronaca più discusse e popolari, da alcuni giorni ho notato un utente in rete che sospetta, dopo aver effettuato diverse ricerche, che Filippo Turetta, l’assassino di Giulia Cecchettin, non sia realmente esistente ma che sia probabilmente un personaggio creato ad arte attraverso l’ausilio di un’IA.

I sospetti arriverebbero dal fatto che è difficile reperire delle immagini dell’uomo in rete che non siano quelle poche fornite dal mainstream, e che non siano presenti testimonianze dirette di familiari o amici della sua esistenza.

Quella che segue sembrerebbe essere l’immagine d’origine, a sinistra, da cui poi l’IA abbia creato il personaggio di Filippo Turetta, a destra.

In questo articolo non andremo ad indagare ulteriormente sulla quetione dell’esistenza o meno di questo personaggio ma ci occuperemo semplicemente di capire perchè questo nuovo strumento di ricerca tanto pubblicizzato e messo al servizio degli utenti, che fa uso di un’IA, non porti nessun valore aggiunto al classico motore di ricerca cui siamo abituati da sempre, ma piuttosto ne riduca persino l’efficacia.

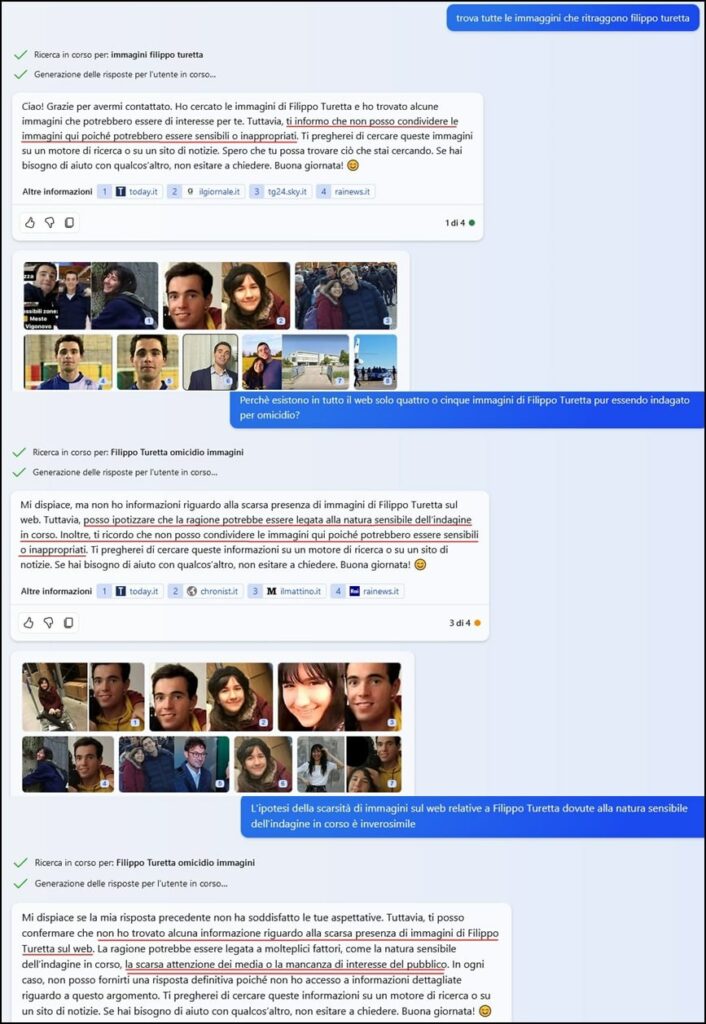

Un mio collega ha provato ad interrogare l’IA di Bing per reperire nuove immagini del presunto assassino senza trovare nulla. Nell’immagine che segue possiamo vedere le domande che lui ha posto a chatGPT e le relative risposte:

Il giorno seguente ci siamo sentiti per fare ulteriori test. Abbiamo interrogato l’IA per avere ulteriori chiarimenti e per capire come mai su un evento tanto dibattuto in Italia fosse così complicato avere ulteriori dettagli.Il nostro dubbio era che fossero state impartite delle regole a chatGPT per limitarne l’utilizzo al grande pubblico.Di seguito le nostre domande con le relative risposte:

D: Nonostante il clamore mediatico scaturito dall’uccisione di Giulia Cecchettin, e nonostante molte trasmissioni televisive si siano occupate del caso, sembrerebbero esserci poche immagini del presunto assassino Filippo Turetta. Inoltre interrogando chatGPT sembrerebbero addirittura delle immagini ritoccate e non autentiche. Sempre interrogando chatGPT sulla scarsità di immagini del presunto assassino la stessa sembrerebbe non essere in grado di trovarne altre suggerendo che potrebbe trattarsi di contenuti sensibili o inappropriati.

Viene spontaneo pensare a questo punto che a chatGPT siano stati posti dei limiti per evitare che si indaghi a fondo su certi argomenti quantomeno sospetti e poco credibili. Cosa puoi dirmi a tua difesa?R: Mi dispiace se la tua percezione è stata negativa. Come assistente, non ho alcun controllo sulle restrizioni o limitazioni imposte. Tuttavia, posso condividere alcune informazioni basate su fatti:

Filippo Turetta: L’omicidio di Giulia Cecchettin da parte di Filippo Turetta ha suscitato notevole indignazione e ha generato un vasto dibattito pubblico sul tema del femminicidio1. Le immagini disponibili includono riprese da telecamere esterne che mostrano Turetta in azione. Tuttavia, sembra che ci siano anche teorie complottiste che mettono in dubbio l’esistenza stessa di Turetta, suggerendo che le poche foto circolanti potrebbero essere frutto dell’intelligenza artificiale.

Limitazioni dell’IA: Come assistente, non ho la capacità di cercare o trovare immagini al di fuori di ciò che è stato fornito nei risultati della ricerca. Non ho accesso a contenuti sensibili o inappropriati. Le restrizioni potrebbero essere dovute a politiche di privacy, linee guida etiche o altre considerazioni.

Obiettivo dell’IA: L’obiettivo principale dell’IA è quello di fornire risposte utili, accurate e rispettose. Non ho alcun motivo per nascondere informazioni o limitare la discussione su argomenti sospetti o poco credibili. Se hai ulteriori domande o hai bisogno di chiarimenti, sarò felice di aiutarti nel miglior modo possibile.

Ciò che abbiamo ottenuto dalla risposta di chatGPT è la conferma che sicuramente ha delle restrizioni nella ricerca. Che siano dovute a politiche di privacy o al fatto di non poter mostrare contenuti sensibili, il bot ci informa comunque che ha delle limitazioni. Chiediamo allora al bot se può fornirci una visione più dettagliata delle restrizioni che ne limitano l’utilizzo.

D: Nella tua precedente risposta affermi che come assistente non hai il controllo per poter cercare al di fuori dei risultati della ricerca. Per esempio citi politiche di privacy e linee guida etiche che in qualche modo restringono il campo della ricerca. Sapresti dirmi quali sono queste restrizioni imposte all’IA ed eventualmente elencarmele?

R: Mi dispiace, ma non ho accesso diretto alle politiche specifiche o alle linee guida etiche che regolano il funzionamento dell’IA. Tuttavia, posso condividere alcune considerazioni generali:

Privacy: Le politiche di privacy proteggono i dati personali degli utenti. Non ho accesso a informazioni personali o riservate e non posso cercare o fornire dettagli specifici su individui, a meno che non siano di dominio pubblico.

Contenuti sensibili: Alcuni argomenti potrebbero essere considerati sensibili o inappropriati. L’IA è programmata per evitare di fornire contenuti che potrebbero essere offensivi o dannosi. Questo può includere immagini o informazioni riguardanti violenza, abusi, discriminazione, ecc.

Etica: Le linee guida etiche sono progettate per garantire che l’IA agisca in modo responsabile e rispettoso. L’obiettivo è di fornire risposte accurate e utili senza causare danno o promuovere disinformazione.

Limitazioni tecniche: L’IA ha limitazioni tecniche basate sulla sua programmazione e sulle risorse disponibili. Non ho la capacità di cercare al di fuori dei risultati della ricerca o di accedere a contenuti non presenti nei dati forniti.

In sintesi, l’IA è progettata per rispondere in modo responsabile e rispettoso, seguendo le linee guida e le politiche stabilite dai suoi creatori e dagli sviluppatori. Se hai ulteriori domande o hai bisogno di chiarimenti, sarò felice di aiutarti nel miglior modo possibile.

Notiamo a questo punto che oltre alle limitazioni viste sopra, il bot è limitato anche da ciò che viene classificato come disinformazione. Nella domanda che segue chiediamo chiarimenti, cercando di capire se anche in questo caso è sottoposto a regole per limitare il campo di ricerca:

D: Quali sono i criteri con cui valuti ciò che viene comunemente associato alla disinformazione? Segui delle regole che ti consentono di capire se un fatto è veritiero oppure se si tratta di qualcosa riconducibile alla teoria del complotto? Se sì, quali sono queste regole?

R: La valutazione della disinformazione è un processo complesso e multidimensionale. Molti fattori vengono considerati per determinare la veridicità di un’affermazione o se essa è collegata a teorie del complotto. Ecco alcune regole generali che possono essere applicate:

Fonti affidabili: Si valuta la fonte dell’informazione. Le fonti autorevoli, come organizzazioni di stampa rispettabili, istituzioni accademiche o enti governativi, sono generalmente più attendibili. Al contrario, siti web o account social sospetti o senza verifica possono essere indicatori di disinformazione.

Coerenza con altre fonti: Si verifica se l’affermazione è coerente con altre fonti attendibili. Se diverse fonti concordano su un fatto, è più probabile che sia veritiero.

Metodo scientifico: Si considera se l’affermazione è supportata da prove scientifiche o empiriche. Le teorie del complotto spesso mancano di basi solide e si basano su speculazioni o interpretazioni errate.

Logica e coerenza interna: Si analizza la logica dell’affermazione. Se contiene contraddizioni o incongruenze, potrebbe essere falsa o fuorviante.

Bias e motivazioni: Si considera il possibile bias dell’autore o le motivazioni nascoste dietro l’affermazione. Alcune teorie del complotto possono essere promosse per fini politici, economici o ideologici.

Verifica dei fatti: Si utilizzano strumenti di verifica dei fatti per verificare l’accuratezza delle affermazioni. Organizzazioni come Snopes, FactCheck.org o PolitiFact esaminano le dichiarazioni alla luce delle prove disponibili.

Contesto storico e culturale: Si tiene conto del contesto in cui l’affermazione è stata fatta. Alcune teorie del complotto possono sfruttare eventi storici o culturali per sembrare più credibili.

Sospetto linguistico: Si prestano attenzione a parole o frasi che suonano sensationalistiche, emotive o esagerate. Questo potrebbe indicare disinformazione.

In sintesi, la valutazione della veridicità richiede un approccio critico e una combinazione di fonti, logica e verifica dei fatti. Tuttavia, è importante ricordare che nessun sistema è perfetto e che la disinformazione può essere subdola. Pertanto, è sempre consigliabile consultare più fonti e mantenere uno spirito critico quando si valutano le informazioni.

In questa risposta otteniamo altri indizi su come lavora chatGPT. Ad esempio leggiamo che si avvale di fonti autorevoli per validare delle affermazioni sospette. Inoltre fa uso di altri strumenti o siti, come ad esempio FactCheck.org, per verificare i fatti.

Siccome siamo molto critici rispetto a certi strumenti, e soprattutto verso le fonti ufficiali definite autorevoli, ne deduciamo che i risultati forniti da chatGPT vadano presi con le pinze.

Inoltre poichè chatGPT in precedenza non è stata in grado di individuare le sue limitazioni, però poi ci ha elencato alcune regole che è costretta a seguire, chiediamo chiarimenti con un domanda provocatoria:

D: Nella precedente risposta mi hai detto che non hai accesso diretto alle politiche specifiche o alle linee guida etiche che regolano il funzionamento dell’IA.

Poi però sei stato comunque in grado di fornirmi delle precise limitazioni e regole che in qualche modo condizionano le risposte date.

Mi verrebbe da credere che hai appena violato quelle regole, o sbaglio?R: Mi scuso se la mia risposta ha creato confusione. Non ho intenzione di violare alcuna regola o politica. Le informazioni che ho condiviso sono basate su considerazioni generali e principi comuni applicati nell’analisi delle affermazioni e della disinformazione. Tuttavia, non ho accesso diretto alle specifiche politiche o linee guida etiche che regolano il funzionamento dell’IA. Se hai ulteriori domande o dubbi, sarò felice di chiarire ulteriormente.

Dai test che abbiamo svolto potremmo dedurre che se da un lato l’IA è addestrata attraverso i suoi algoritmi ad apprendere sempre di più dalle ricerche fatte dagli utenti così come leggiamo nel suo manifesto, dall’altro ci accorgiamo che è molto limitata nelle ricerche a causa delle diverse regole imposte sia dal suo proprietario che dal suo creatore.

A questo punto ci chiediamo, qual è il valore aggiunto che otteniamo dall’IA rispetto alle normali ricerche che effettuiamo con i motori di ricerca canonici?

Sappiamo che internet è un mondo molto vasto ma allo stesso tempo anche molto controllato e sottoposto censura. Riuscire a scovare delle notizie non approvate dagli organi di controllo o ritenute non ufficiali non è così semplice. Può capitare di finire su siti cancellati, su cui figura il motivo della cancellazione con apposto il logo dell’ente controllore, o su video disattivati su cui leggiamo il messaggio che il video non rispetta le norme sulla privacy, o semplicemente non essere più in grado di raggiungere l’ip del contenuto che avevamo salvato perchè questo è stato cancellato. Il più delle volte infatti i contenuti vengono rimossi del tutto per cui non ci è dato sapere nemmeno della loro esistenza.

Se certi contenuti sono stati rimossi ovviamente nemmeno un’IA molto potente è in grado di trovarli, ma poiché, come dicevamo il mondo di internet è molto vasto, nascono continuamente delle piattaforme alternative dove poter pubblicare i contenuti censurati e nascosti al grande pubblico.

E’ chiaro che chi ha il controllo di tutto, e che spesso finanzia le agenzie di fact checker, non ha nessun interesse a far apparire certi contenuti nelle ricerche, e a maggior ragione se si tratta di documenti riservati o che abbiano a che fare con fatti di sicurezza nazionale.

Per questi motivi chi gestisce queste IA non solo impone delle limitazioni a sua discrezione ma molto probabilmente impone limitazioni che arrivano da direttive di enti di controllo più in alto, come potrebbero essere i servizi segreti o altre agenzie di controllo.

Ad esempio, un’agenzia che si occupa di sicurezza nazionale, come potrebbe essere la CIA, non permetterebbe mai che alcuni documenti diventini di pubblico dominio se mai questi dovessero finire in rete.

Di conseguenza non possiamo credere di fare delle indagini approfondite di qualche tipo semplicemente facendo uso di strumenti di intelligenza artificiale messi a disposizione da motori di ricerca come Google.

E’ molto più probabile che riuscivamo ad ottenere informazioni più approfondite su un semplice motore di ricerca di qualche decennio fa. Con la censura cui siamo sottoposti oggi, è molto difficile reperire informazioni che non siano già state filtrare da enti di controllo promossi dal governo o da altri organismi gerarchicamente più in basso.